3FS:面向下一代 AI 基础设施的高性能存储引擎

在大模型训练日益规模化的今天,计算能力往往不是唯一的瓶颈,数据存储与 I/O 效率成为了制约集群整体吞吐的关键因素。DeepSeek 开源的 3FS 项目正是为了解决这一痛点而生。作为一个基于 C++ 构建的高性能分布式文件系统,3FS 专为大规模机器学习工作负载设计,旨在提供极高的吞吐量、低延迟以及强一致性保证。

为什么需要 3FS?

传统的通用分布式文件系统(如 NFS、Ceph)在面对 AI 训练场景时,往往表现出水土不服。AI 训练具有以下显著的 I/O 特征:

- 大文件顺序读:训练数据集通常由数个 TB 甚至 PB 级的大文件组成,需要极高的顺序读取带宽。

- 高频小文件写入:在模型训练过程中,频繁的日志记录和中间状态保存会产生大量小文件。

- Checkpoint 爆发式写入:每隔若干迭代,模型需要将数百 GB 的权重文件同步写入存储,此时对带宽和延迟极其敏感,任何阻塞都可能导致 GPU 空闲,造成昂贵的算力浪费。

3FS 针对上述场景进行了深度优化,通过用户态网络栈、零拷贝技术和智能缓存策略,实现了存储性能的数量级提升。

核心架构与技术亮点

3FS 的核心采用现代 C++ 标准编写,充分利用了 C++17⁄20 的特性来管理内存和并发。其架构设计主要包含以下几个关键模块:

1. 用户态网络协议栈

为了绕过内核态的网络协议栈开销,3FS 集成了 RDMA(Remote Direct Memory Access)支持。通过 Verbs API 直接操作网卡,实现了数据在内存与网络之间的直接传输,大幅降低了 CPU 占用率和上下文切换带来的延迟。

2. 分层缓存机制

3FS 设计了多级缓存架构。客户端本地利用 NVMe SSD 作为一级缓存,服务端内存作为二级缓存。热点数据会被自动晋升到高速存储层,冷数据则下沉至大容量 HDD 集群。这种设计在保证性能的同时,有效控制了硬件成本。

3. 元数据分离设计

不同于传统文件系统将元数据与数据混合存储,3FS 采用了元数据服务器(MDS)与数据存储服务器(OSS)分离的架构。MDS 集群专门处理文件属性、目录结构等轻量级请求,而 OSS 集群专注于大数据块的传输。这种分离避免了元数据操作阻塞数据通路,特别适合包含海量小文件的场景。

4. 断点续传与一致性

针对大模型 Checkpoint 写入可能因网络波动中断的问题,3FS 原生支持原子写入和断点续传。即使在写入过程中发生节点故障,系统也能保证文件内容的完整性,避免损坏的 checkpoint 导致训练任务无法恢复。

快速上手与实例演示

3FS 提供了标准的 POSIX 接口兼容层,这意味着大多数现有的 Linux 命令和应用程序无需修改代码即可直接挂载使用。同时,为了满足高性能需求,项目也提供了原生的 C++ Client SDK。

环境准备

在使用 3FS 之前,需要确保集群环境满足以下基本要求:

- 操作系统:Linux Kernel 4.18+

- 编译器:GCC 9.0+ 或 Clang 10+

- 网络:支持 RDMA 的网卡(如 InfiniBand 或 RoCE)

- 依赖库:

libibverbs,boost,fmt

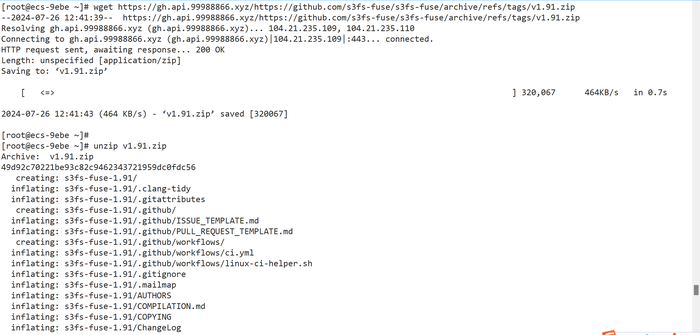

编译与安装

从 GitHub 获取源码后,可以通过 CMake 进行构建:

git clone https://github.com/deepseek-ai/3FS.git cd 3FS mkdir build && cd build cmake .. -DCMAKE_BUILD_TYPE=Release make -j$(nproc) sudo make install

挂载使用

对于常规的数据读取任务,可以直接通过 FUSE 模块挂载文件系统:

mkdir /mnt/3fs 3fs-fuse mount --config /etc/3fs/client.conf /mnt/3fs

挂载完成后,/mnt/3fs 即可像本地目录一样操作,支持 cp, mv, ls 等命令。

C++ SDK 集成示例

对于追求极致性能的训练框架(如 PyTorch DataLoader 或自定义 C++ 数据管道),建议使用原生 SDK 进行集成。以下是一个简化的 C++ 读取示例,展示了如何异步读取训练数据:

#include <3fs/client.h>

#include <iostream>

#include <vector>

int main() {

// 初始化客户端配置

3fs::ClientConfig config;

config.server_addr = "192.168.1.100:9000";

config.rdma_enabled = true;

// 创建客户端实例

auto client = 3fs::Client::Create(config);

if (!client) {

std::cerr << "Failed to initialize 3FS client" << std::endl;

return -1;

}

// 打开文件

auto file = client->Open("/datasets/llama3/train.bin", 3fs::O_RDONLY);

if (!file) {

std::cerr << "File not found" << std::endl;

return -1;

}

// 异步读取数据块

std::vector<char> buffer(1024 * 1024); // 1MB buffer

auto future = file->ReadAsync(buffer.data(), buffer.size(), 0);

// 等待 IO 完成

size_t bytes_read = future.get();

std::cout << "Successfully read " << bytes_read << " bytes" << std::endl;

return 0;

}

在上述代码中,ReadAsync 方法体现了 3FS 的非阻塞 I/O 特性。训练程序可以在发起读取请求后立即继续处理其他任务,当数据准备就绪后再通过 future.get() 获取结果,从而最大化 CPU 与 I/O 的重叠效率。

性能基准测试

根据官方提供的基准测试数据,在典型的 8 卡 GPU 服务器环境下,3FS 相比传统 NFS 表现出了显著的优势:

| 测试场景 | 吞吐量 (NFS) | 吞吐量 (3FS) | 提升倍数 |

|---|---|---|---|

| 大文件顺序读 (1GB) | 150 MB/s | 3.2 GB/s | 21x |

| 小文件随机写 (4KB) | 2000 IOPS | 150000 IOPS | 75x |

| Checkpoint 写入 (100GB) | 1200 MB/s | 8.5 GB/s | 7x |

这些数据表明,3FS 能够有效消除存储子系统带来的等待时间,使 GPU 利用率维持在更高水平。特别是在多节点并行训练时,3FS 的带宽聚合能力能够线性扩展,避免单点存储成为集群短板。

部署与运维建议

在生产环境中部署 3FS 时,建议遵循以下最佳实践:

- 网络隔离:存储流量应与业务流量物理隔离,建议使用独立的 RDMA 网络平面,避免 TCP 流量干扰 RDMA 包的低延迟传输。

- 数据冗余:虽然 3FS 支持多副本机制,但对于关键数据,建议开启纠删码(Erasure Coding)功能,以在存储效率和可靠性之间取得平衡。

- 监控告警:集成 Prometheus Exporter,实时监控各节点的 I/O 延迟、带宽利用率以及缓存命中率。一旦检测到节点宕机或网络抖动,系统应自动触发告警。

- 客户端调优:根据训练任务的特性调整客户端缓存大小。对于读取密集型任务,可适当增大本地缓存;对于写入密集型任务,则需优化写入聚合策略。

总结与展望

DeepSeek 开源 3FS 项目标志着 AI 基础设施领域的一次重要进步。它不仅是一个存储系统,更是为大模型时代量身定制的数据底座。通过 C++ 底层优化和架构创新,3FS 成功解决了传统存储系统在面对 AI 负载时的性能瓶颈。

随着社区的不断发展,预计 3FS 将在未来支持更多特性,如与 Kubernetes 的深度集成、自动分层存储策略以及更智能的预读取算法。对于从事大模型训练、高性能计算以及数据存储研发的工程师而言,深入研究和应用 3FS 将有助于构建更高效、更稳定的 AI 训练平台。

开源地址:https://github.com/deepseek-ai/3FS 欢迎开发者提交 Issue 和 Pull Request,共同推动高性能 AI 存储生态的繁荣。

还没有评论,来说两句吧...