引言:大模型部署的痛点

在人工智能技术飞速发展的今天,大语言模型(LLM)已经成为了开发者、研究人员乃至普通用户关注的焦点。然而,想要在本地运行一个开源大模型,往往面临着繁琐的环境配置过程。用户通常需要安装特定版本的 Python、配置虚拟环境、安装 PyTorch 或 TensorFlow 依赖、处理 CUDA 驱动兼容性问题,甚至需要编译复杂的 C++ 后端。对于 Windows 用户而言,权限问题和路径配置更是令人头疼。这种高门槛极大地阻碍了大模型技术的普及与落地。

Mozilla AI 推出的 llamafile 项目正是为了解决这一痛点而生。它旨在将大模型推理引擎与模型权重打包成一个单一的可执行文件,实现“下载即运行”的极致体验。该项目基于 C++ 开发,结合了 llama.cpp 的高效推理能力与 cosmocc 的跨平台编译技术,为本地 AI 部署提供了一种全新的范式。

llamafile 是什么

llamafile 是一个开源项目,其核心理念是将大语言模型及其运行所需的所有代码捆绑在一个单独的文件中。这个文件本身就是一个可执行程序,用户无需安装任何额外的软件依赖,只需下载该文件,赋予执行权限,即可直接在操作系统上运行。

该项目由 Mozilla AI 团队维护,致力于推动开放、可访问的人工智能技术。llamafile 不仅支持多种主流开源模型格式(如 GGUF),还提供了 HTTP API 接口,兼容 OpenAI 的 API 标准,使得开发者可以轻松地将本地模型集成到现有的应用程序中。无论是 Windows、macOS 还是 Linux,llamafile 都能提供一致的运行体验,真正实现了“一次构建,到处运行”。

核心技术原理

llamafile 之所以能够实现单文件分发,主要依赖于以下几项关键技术的结合:

1. 可执行 zip 架构

llamafile 本质上是一个经过特殊处理的可执行文件。它利用了操作系统的特性,将二进制代码和数据文件打包在一起。在文件头部是可执行的机器码,而模型权重则存储在文件的尾部,类似于 zip 归档。当程序启动时,它会自我解压或直接映射内存中的模型数据,从而无需外部文件支持。

2. cosmocc 跨平台编译

为了实现跨平台兼容,llamafile 使用了 cosmocc 编译器工具链。这是一个能够生成“通用二进制文件”的编译器,生成的可执行文件可以在多种不同的操作系统和 CPU 架构上运行。这意味着开发者只需要编译一次,生成的 llamafile 就可以分发给使用不同操作系统的用户,极大地简化了分发流程。

3. llama.cpp 后端

在推理引擎方面,llamafile 深度集成了 llama.cpp。这是一个用纯 C/C++ 编写的高效大模型推理库,专注于在消费级硬件上运行量化模型。llama.cpp 支持多种量化格式,能够显著降低内存占用并提高推理速度。llamafile 继承了这一优势,使得即使在没有高端 GPU 的设备上,也能流畅运行数十亿参数规模的模型。

4. 内嵌 Web 服务器

为了方便用户交互,llamafile 内置了一个轻量级的 Web 服务器。当启动程序时,它会自动监听本地端口,并提供一个基于浏览器的聊天界面。用户无需编写任何代码,即可通过网页与模型进行对话。此外,该服务器还暴露了 API 端点,供外部程序调用。

快速上手指南

体验 llamafile 非常简单,以下是在不同操作系统上的基本使用步骤。

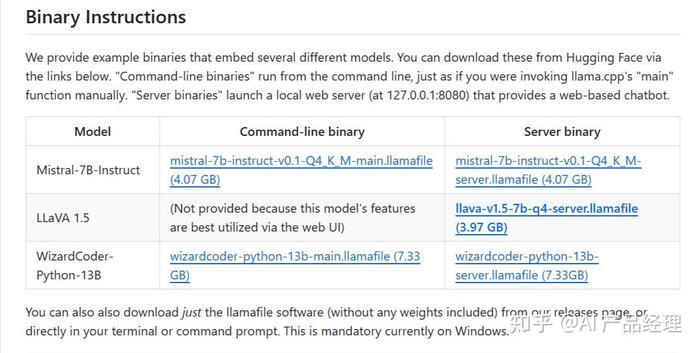

下载与准备

首先,用户需要访问 llamafile 的官方发布页面或 Hugging Face 仓库,下载预构建的二进制文件。常见的文件名格式为 model-name.llamafile。例如,若要运行 Llama 3 模型,可能下载的文件名为 llama-3-8b-instruct.llamafile。

Windows 系统

在 Windows 上,下载完成后,双击该文件即可运行。如果系统提示安全警告,需要选择“更多信息”并点击“仍要运行”。程序启动后,会自动打开默认浏览器,跳转到本地地址(通常是 http://127.0.0.1:8080),用户即可在网页界面中进行对话。

Linux 与 macOS 系统

在类 Unix 系统上,需要先赋予文件执行权限。打开终端,进入下载目录,执行以下命令:

chmod +x llama-3-8b-instruct.llamafile ./llama-3-8b-instruct.llamafile

运行后,终端会显示服务器启动日志,同样可以通过浏览器访问本地端口进行使用。如果需要后台运行,可以结合 nohup 或 screen 工具。

命令行参数

llamafile 支持丰富的命令行参数,允许用户自定义运行行为。常用参数包括:

--host: 指定监听的网络地址,默认为本地。--port: 指定服务端口,默认为 8080。--threads: 指定使用的 CPU 线程数。--gpu: 启用 GPU 加速,支持 Vulkan、CUDA 等后端。--api: 仅启动 API 服务,不打开浏览器界面。

例如,若要启用 GPU 加速并指定端口为 9000,命令如下:

./llama-3-8b-instruct.llamafile --port 9000 --gpu

高级用法与 API 集成

除了交互式聊天,llamafile 的强大之处在于其兼容 OpenAI 格式的 API。这使得它可以无缝替代云端 API,用于开发本地化的 AI 应用。

API 调用示例

llamafile 启动后,会暴露 /v1/chat/completions 端点。开发者可以使用标准的 HTTP 请求库与之交互。以下是一个使用 Python 调用本地 llamafile 服务的示例:

import requests

url = "http://127.0.0.1:8080/v1/chat/completions"

headers = {"Content-Type": "application/json"}

data = {

"messages": [

{"role": "system", "content": "你是一个有用的助手。"},

{"role": "user", "content": "请解释什么是量子纠缠。"}

],

"temperature": 0.7,

"max_tokens": 500

}

response = requests.post(url, json=data, headers=headers)

print(response.json()['choices'][0]['message']['content'])

这段代码展示了如何向本地模型发送指令并获取回复。由于 API 标准与 OpenAI 一致,许多现有的基于 LangChain 或 LlamaIndex 构建的应用只需更改 Base URL 即可切换到本地模型。

嵌入与微调

部分 llamafile 版本还支持向量嵌入(Embeddings)功能,允许用户构建本地知识库检索系统(RAG)。通过调用 /v1/embeddings 接口,可以将文本转换为向量,存储在本地向量数据库中,从而实现隐私安全的数据查询。虽然目前主要侧重于推理,但社区正在积极探索基于 llamafile 的微调工作流,未来可能支持直接在单文件环境中进行 LoRA 微调。

应用场景分析

llamafile 的特性使其在多个场景下具有独特的优势。

1. 隐私敏感型应用

对于医疗、法律、金融等对数据隐私要求极高的行业,将数据发送到云端存在合规风险。llamafile 允许企业在内部服务器上部署模型,所有数据处理均在本地完成,确保敏感信息不出内网。

2. 离线环境部署

在无法连接互联网的环境中,如涉密单位、远洋船舶或野外工作站,云端 API 无法使用。llamafile 的单文件特性使得通过物理介质(如 U 盘)传输模型变得异常简单,无需复杂的离线依赖安装过程。

3. 教育与演示

教师或技术布道师在进行大模型演示时,往往受限于现场网络环境或设备配置差异。使用 llamafile,演示者只需携带一个文件,即可在任何电脑上瞬间启动演示环境,避免了现场配置环境失败的尴尬。

4. 边缘计算设备

随着硬件性能的提升,越来越多的边缘设备具备了运行大模型的能力。llamafile 的轻量级特性使其适合部署在嵌入式 Linux 设备或高性能单板计算机上,实现端侧智能。

性能与局限性

尽管 llamafile 带来了极大的便利,但用户也需了解其性能边界。

推理速度

由于 llamafile 主要依赖 CPU 推理(虽然支持 GPU 加速,但配置相对通用),其推理速度可能不如专门优化的 GPU 后端(如 vLLM 或 TensorRT-LLM)。对于实时性要求极高的应用,可能需要评估延迟是否可接受。

文件大小

单文件包含了模型权重,因此文件体积较大。一个 7B 参数的量化模型文件通常在 4GB 左右,而 70B 模型则可能超过 40GB。这对存储空间和网络下载速度提出了一定要求。

功能更新

相比于快速迭代的 Python 生态,C++ 二进制文件的更新频率可能较低。用户需要手动下载新版本文件来获取新功能或安全补丁,无法通过包管理器自动升级。

总结与展望

llamafile 项目是大模型基础设施领域的一次重要创新。它通过工程化的手段,极大地降低了本地运行大模型的门槛,让 AI 技术变得更加普惠和易用。对于开发者而言,它提供了一个标准化的本地推理后端;对于普通用户,它赋予了完全掌控模型数据的能力。

随着硬件算力的持续提升和模型量化技术的进步,未来我们有理由相信,单文件运行更大参数规模的模型将成为常态。llamafile 及其背后的技术理念,有望成为本地 AI 部署的标准格式之一,推动人工智能从云端走向终端,从集中走向分布。在隐私保护日益重要的今天,这种“数据不出域”的部署方式,或许正是下一代 AI 应用架构的关键基石。

还没有评论,来说两句吧...