引言:小文件存储的挑战与机遇

在互联网架构演进的过程中,图片、头像、缩略图等海量小文件的存储始终是一个棘手的技术难题。传统的对象存储方案在面对亿级文件数量时,往往受限于 inode 数量、元数据管理效率以及网络 IO 吞吐瓶颈。由 Go 语言社区知名开发者 Terry-Mao 开源的 bfs 分布式文件系统,正是为了解决这一特定场景而诞生的高性能解决方案。该项目凭借 Go 语言天然的并发优势与简洁的语法特性,构建了一套轻量级、高可用且易于扩展的存储架构,成为众多中小企业构建私有云存储的首选参考实现。

bfs 核心架构设计解析

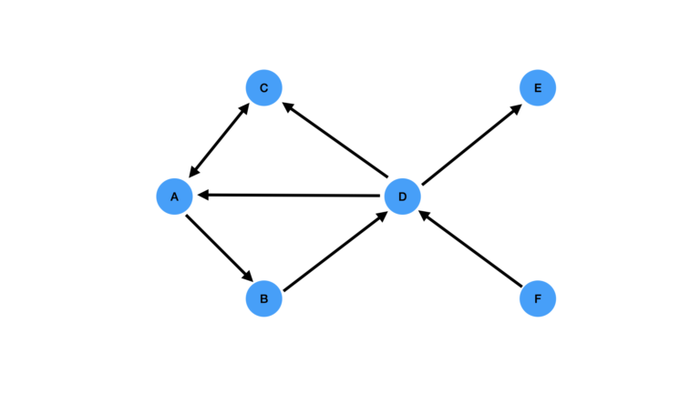

bfs 的设计哲学遵循了计算与存储分离、元数据与数据分离的原则。整个系统主要由 Tracker、Store 和 Volume 三大核心组件构成,各组件之间通过高效的内部协议进行通信,对外则统一提供标准的 HTTP 接口。

1. Tracker 服务:集群的大脑

Tracker 节点负责维护整个集群的元数据信息,包括 Store 节点的状态、Volume 的分布情况以及文件的路由映射。它不直接存储文件数据,而是充当调度中心的角色。当客户端发起上传请求时,Tracker 会根据一致性哈希算法或负载均衡策略,指派具体的 Store 节点处理写入操作。这种设计避免了单点故障,支持 Tracker 集群化部署,确保元数据服务的高可用性。

2. Store 服务:数据的中转站

Store 节点是数据写入的实际接收者。它接收来自客户端或 CDN 边缘节点的文件流,并将其转发至后端的 Volume 存储单元。Store 层实现了连接池管理、流量控制以及基本的容错逻辑。在高并发场景下,Store 能够有效地缓冲写入压力,防止后端磁盘 IO 被打满,同时支持多副本策略,确保数据在落盘前的安全性。

3. Volume 服务:持久化存储单元

Volume 是 bfs 中最底层的存储实体,直接操作物理磁盘。每个 Volume 对应磁盘上的一个目录,内部管理文件的物理偏移量与索引。为了优化小文件读取性能,Volume 采用了追加写(Append Only)的方式,将多个小文件合并写入大文件中,从而减少磁盘寻道时间。这种机制显著提升了随机写转化为顺序写的效率,极大延长了磁盘寿命并提高了吞吐能力。

关键特性与技术优势

bfs 之所以在 Go 语言存储领域占据重要地位,得益于其多项关键技术特性。首先是高性能的网络模型,基于 Go 的 net/http 库进行了深度定制,支持长连接与连接复用,减少了 TCP 握手带来的延迟。其次是一致性哈希环的运用,使得节点扩容或缩容时,仅需迁移少量数据,实现了真正的线性扩展能力。

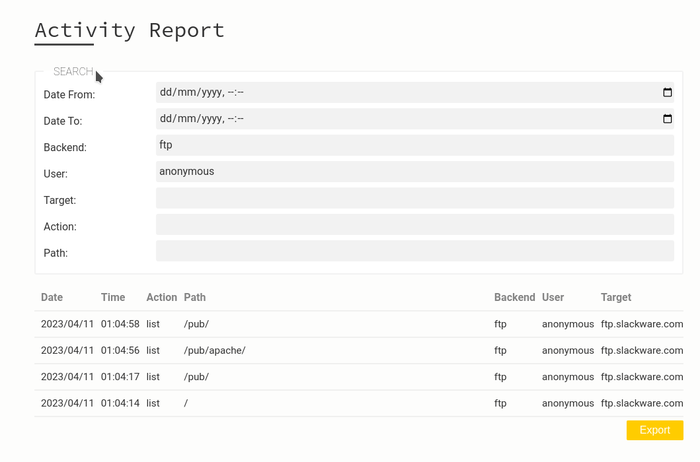

此外,项目内置了完善的监控指标暴露接口,兼容 Prometheus 等主流监控体系,运维人员可以实时查看 QPS、延迟、磁盘使用率等关键数据。在安全性方面,bfs 支持 Token 鉴权机制,防止未经授权的访问与盗链行为,特别适合用于对外公开的图片 CDN 后端存储。

快速部署与配置指南

部署 bfs 集群需要准备至少三台服务器,分别部署 Tracker、Store 和 Volume 组件。以下以 Linux 环境为例,简述核心配置步骤。

首先,克隆项目源码并编译二进制文件:

git clone https://github.com/Terry-Mao/bfs.git cd bfs make all

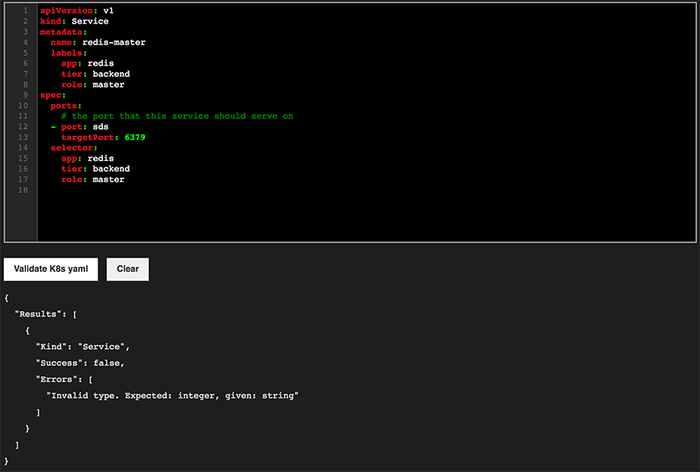

编译完成后,需修改配置文件。Tracker 的配置文件 tracker.conf 中需指定集群内 Store 节点的地址列表。Store 的配置文件 store.conf 则需要绑定本地监听端口以及后端 Volume 的路径。Volume 配置相对简单,主要指定数据存放的物理目录以及最大文件大小限制。

启动服务顺序至关重要,必须先启动 Volume,再启动 Store,最后启动 Tracker。例如:

./bin/bfs_volume -c conf/volume.conf ./bin/bfs_store -c conf/store.conf ./bin/bfs_tracker -c conf/tracker.conf

服务启动后,可通过 curl 命令访问健康检查接口验证集群状态,确保各组件间心跳正常。

代码实战:Go 客户端上传示例

在实际业务中,开发者通常通过 HTTP 协议与 bfs 交互。以下是一个基于 Go 标准库实现的文件上传客户端示例,展示了如何将本地图片上传至 bfs 集群。

package main

import (

"bytes"

"fmt"

"io/ioutil"

"mime/multipart"

"net/http"

"os"

)

func uploadFile(url string, filepath string) error {

file, err := os.Open(filepath)

if err != nil {

return err

}

defer file.Close()

bodyBuf := &bytes.Buffer{}

bodyWriter := multipart.NewWriter(bodyBuf)

fileWriter, err := bodyWriter.CreateFormFile("file", filepath)

if err != nil {

return err

}

_, err = ioutil.Copy(fileWriter, file)

if err != nil {

return err

}

contentType := bodyWriter.FormDataContentType()

bodyWriter.Close()

resp, err := http.Post(url, contentType, bodyBuf)

if err != nil {

return err

}

defer resp.Body.Close()

if resp.StatusCode != http.StatusOK {

return fmt.Errorf("upload failed, status: %d", resp.StatusCode)

}

return nil

}

func main() {

err := uploadFile("http://tracker-host:8080/upload", "./avatar.png")

if err != nil {

fmt.Println("Error:", err)

} else {

fmt.Println("Upload successful")

}

}

上述代码通过构建 multipart 表单数据,模拟浏览器行为向 Tracker 地址发送 POST 请求。上传成功后,bfs 会返回文件的唯一标识符或访问 URL,业务系统只需将该 URL 存入数据库即可实现文件的持久化引用。

生产环境优化建议

虽然 bfs 默认配置已能满足大多数场景,但在生产环境部署时仍需进行针对性调优。操作系统层面,建议调整文件描述符限制(ulimit),因为高并发存储服务需要消耗大量 FD。磁盘 IO 调度算法建议改为 deadline 或 noop,以减少内核态的合并开销。

网络方面,若集群跨机房部署,需充分考虑带宽成本与延迟问题,建议在同一可用区内部署完整的 Store 与 Volume 副本。对于读多写少的场景,前端应配合 Nginx 或 Varnish 构建多级缓存,减少对 bfs 后端的直接请求。此外,定期清理碎片文件与监控磁盘 inode 使用率也是日常运维的重点工作,防止因元数据耗尽导致服务不可用。

总结与展望

Terry-Mao 的 bfs 项目不仅是一个可用的分布式存储系统,更是学习 Go 语言系统编程的优秀教材。它展示了如何利用 Go 的并发模型处理网络 IO,如何设计一致性的哈希环,以及如何优化磁盘读写路径。对于需要自建图片存储平台的技术团队而言,bfs 提供了一个轻量、可控且高效的基线方案。随着云原生技术的发展,未来该项目若能进一步整合 Kubernetes Operator 与容器化部署,将在现代化基础设施中发挥更大的价值。理解并掌握 bfs 的架构思想,对于提升后端工程师在存储领域的设计能力具有深远意义。

还没有评论,来说两句吧...