XGBoost:C++ 实现的高性能梯度提升框架

项目概述

XGBoost(eXtreme Gradient Boosting)是一个开源、分布式、高性能的梯度提升框架,最初由陈天奇博士开发。该项目采用 C++ 作为核心实现语言,提供了多种编程语言接口,包括 Python、R、Java、Scala 等,是目前机器学习竞赛和工业界应用中最受欢迎的算法之一。

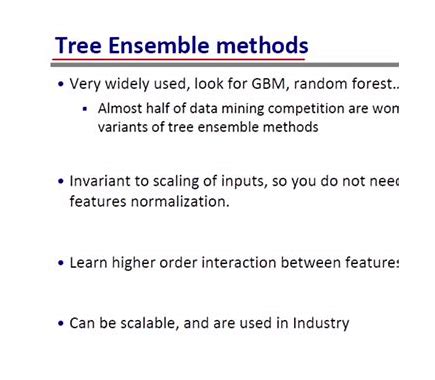

核心特性

1. 高性能与可扩展性

- C++ 核心实现:底层采用高效的 C++ 代码,确保计算性能最大化

- 并行处理:支持多线程并行计算,充分利用现代 CPU 的多核架构

- 分布式训练:支持在 Hadoop、Spark 等分布式环境中运行

- 内存优化:采用特殊的数据结构和算法减少内存使用

2. 算法优势

- 正则化提升:在目标函数中加入正则化项,防止过拟合

- 处理缺失值:内置处理缺失值的机制

- 特征重要性评估:自动计算特征重要性分数

- 多种目标函数:支持回归、分类、排序等多种任务

3. 跨平台支持

- 支持 Windows、Linux、macOS 等主流操作系统

- 提供多种语言接口,便于不同技术栈的开发者使用

安装与配置

从源码编译(C++ 版本)

text

# 克隆项目 git clone --recursive https://github.com/dmlc/xgboost.git cd xgboost # 创建构建目录 mkdir build cd build # 配置和编译 cmake .. make -j4 # 安装 sudo make install

使用 CMake 配置选项

text

# 启用 OpenMP 支持 cmake .. -DUSE_OPENMP=ON # 启用 GPU 支持(需要 CUDA) cmake .. -DUSE_CUDA=ON # 构建共享库 cmake .. -DBUILD_SHARED_LIBS=ON

C++ API 使用示例

基本数据加载与训练

text

#include <xgboost/c_api.h>

#include <vector>

#include <iostream>

int main() {

// 创建数据集

float data[] = {1.0, 2.0, 3.0, 4.0, 5.0, 6.0};

float labels[] = {0.0, 1.0, 0.0, 1.0, 0.0, 1.0};

// 创建 DMatrix(XGBoost 的数据结构)

DMatrixHandle train_matrix;

XGDMatrixCreateFromMat(data, 6, 1, -1.0, &train_matrix);

// 设置标签

XGDMatrixSetFloatInfo(train_matrix, "label", labels, 6);

// 创建 booster

BoosterHandle booster;

XGBoosterCreate(&train_matrix, 1, &booster);

// 设置参数

XGBoosterSetParam(booster, "objective", "binary:logistic");

XGBoosterSetParam(booster, "max_depth", "3");

XGBoosterSetParam(booster, "eta", "0.3");

XGBoosterSetParam(booster, "silent", "1");

// 训练模型

for (int i = 0; i < 10; ++i) {

XGBoosterUpdateOneIter(booster, i, train_matrix);

}

// 保存模型

XGBoosterSaveModel(booster, "xgboost.model");

// 清理资源

XGBoosterFree(booster);

XGDMatrixFree(train_matrix);

return 0;

}

高级特征工程与交叉验证

text

#include <xgboost/c_api.h>

#include <random>

#include <vector>

// 生成模拟数据

std::vector<float> generate_data(int n_samples, int n_features) {

std::random_device rd;

std::mt19937 gen(rd());

std::uniform_real_distribution<> dis(0.0, 1.0);

std::vector<float> data(n_samples * n_features);

for (auto& val : data) {

val = dis(gen);

}

return data;

}

int main() {

const int n_samples = 1000;

const int n_features = 20;

// 生成训练数据

auto train_data = generate_data(n_samples, n_features);

std::vector<float> labels(n_samples);

// 简单规则生成标签

for (int i = 0; i < n_samples; ++i) {

float sum = 0.0;

for (int j = 0; j < n_features; ++j) {

sum += train_data[i * n_features + j];

}

labels[i] = (sum > n_features / 2.0) ? 1.0 : 0.0;

}

// 创建 DMatrix

DMatrixHandle dmat;

XGDMatrixCreateFromMat(train_data.data(), n_samples, n_features, 0.0, &dmat);

XGDMatrixSetFloatInfo(dmat, "label", labels.data(), n_samples);

// 配置交叉验证参数

const char* params[] = {

"objective=binary:logistic",

"max_depth=4",

"eta=0.1",

"subsample=0.8",

"colsample_bytree=0.8",

"eval_metric=auc",

"seed=42"

};

int n_params = sizeof(params) / sizeof(params[0]);

// 执行交叉验证

const int n_folds = 5;

const int n_rounds = 100;

BoosterHandle cv_result;

XGBoosterCV(

&dmat, // 数据矩阵

params, n_params, // 参数

n_rounds, // 迭代轮数

n_folds, // 折数

0, // 是否打乱

0, // 是否输出进度

0, // 是否输出评估结果

&cv_result // 结果句柄

);

// 获取最佳迭代轮数

bst_ulong out_len;

const char* out_result;

XGBoosterEvalOneIter(cv_result, 0, &out_len, &out_result);

std::cout << "CV Results: " << out_result << std::endl;

// 清理资源

XGBoosterFree(cv_result);

XGDMatrixFree(dmat);

return 0;

}

性能优化技巧

1. 内存管理优化

text

// 使用自定义数据加载器减少内存拷贝

class CustomDataLoader {

public:

void load_data_batch(int batch_size,

std::vector<float>& batch_data,

std::vector<float>& batch_labels) {

// 实现自定义数据加载逻辑

// 可以支持流式数据加载、数据增强等

}

};

// 使用稀疏矩阵格式处理高维稀疏数据

void use_sparse_matrix() {

// XGBoost 支持 CSR、CSC 等稀疏格式

// 适合处理文本特征、推荐系统等场景

}

2. 并行处理配置

text

void configure_parallel_training() {

// 设置线程数(通常设置为 CPU 核心数)

XGBoosterSetParam(booster, "nthread", "8");

// 启用 GPU 加速(如果可用)

XGBoosterSetParam(booster, "tree_method", "gpu_hist");

XGBoosterSetParam(booster, "gpu_id", "0");

}

实际应用场景

1. 金融风控

text

// 信用评分模型

void build_credit_scoring_model() {

// 特征工程:用户历史行为、征信数据、交易记录等

// 使用 XGBoost 进行二分类预测

// 输出违约概率

}

2. 推荐系统

text

// 点击率预测

void build_ctr_prediction_model() {

// 处理高维稀疏特征(用户ID、物品ID、上下文特征)

// 使用 XGBoost 的稀疏矩阵支持

// 实时预测用户点击概率

}

3. 异常检测

text

// 工业设备异常检测

void build_anomaly_detection_model() {

// 处理时间序列数据

// 使用 XGBoost 的多输出回归

// 检测设备运行异常

}

最佳实践建议

- 特征工程:虽然 XGBoost 能处理非线性关系,但好的特征工程仍然重要

- 参数调优:使用网格搜索或贝叶斯优化进行超参数调优

- 早停策略:使用验证集进行早停,防止过拟合

- 模型解释:结合 SHAP 值等工具进行模型解释

- 生产部署:使用 ONNX 格式或原生 C++ 接口进行高性能部署

总结

XGBoost 的 C++ 实现提供了极高的性能和灵活性,使其成为处理大规模数据集的理想选择。通过合理的配置和优化,XGBoost 可以在保持高精度的同时,显著提升训练和推理速度。无论是学术研究还是工业应用,XGBoost 都是一个值得深入学习和使用的强大工具。

项目持续活跃开发,拥有活跃的社区支持,定期发布新版本和性能优化,是机器学习领域的重要基础设施之一。

xgboost_20260205142949.zip

类型:压缩文件|已下载:0|下载方式:免费下载

立即下载

还没有评论,来说两句吧...