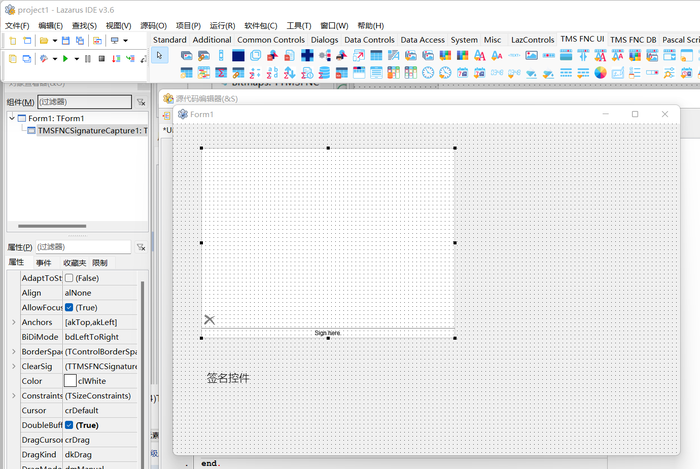

什么是 DataLank?

DataLank 是一个用 Pascal 语言编写的轻量级数据集成工具。它的核心目标是简化“数据搬运”过程——将数据从一个源(Source)高效地传输到另一个目的地(Destination),而无需编写复杂的 ETL(提取、转换、加载)脚本或部署沉重的企业级中间件。

在现代数据工程中,我们经常面临需要将 CSV 文件导入数据库、将 API 响应同步到本地存储或在不同数据库之间迁移数据的需求。DataLank 提供了一种声明式的、模块化的方式来处理这些任务,让开发者能够专注于数据流向,而非底层连接细节。

核心设计理念

DataLank 的设计遵循了三个关键原则:

- 解耦(Decoupling):源端和目的端完全独立。这意味着你可以随意组合不同的输入和输出模块,而不需要为每一种组合编写特定的代码。

- 类型安全(Type Safety):得益于 Pascal 语言的强类型特性,DataLank 在处理数据流时能够提供极高的稳定性,减少运行时因类型不匹配导致的崩溃。

- 轻量化(Lightweight):它不依赖于庞大的运行时环境,编译后即可生成高效的可执行文件,适合在资源受限的边缘设备或简单的自动化脚本中使用。

关键功能特性

1. 灵活的适配器架构

DataLank 采用了插件式的适配器模式。它定义了一套标准的接口,使得增加新的数据源或目的地变得非常简单: - Source 适配器:负责读取数据(如:文件系统、SQL 数据库、HTTP 接口)。 - Destination 适配器:负责写入数据(如:JSON 文件、关系型数据库、日志系统)。

2. 流式处理

为了处理大规模数据集,DataLank 采用了流式传输机制。数据不会一次性全部加载到内存中,而是以记录(Record)或块(Chunk)的形式在管道中流动,极大地降低了内存占用。

3. 简单的配置驱动

用户可以通过配置文件或简单的代码定义来指定数据流的路径,无需深入修改核心源代码即可实现不同的业务逻辑。

快速上手实例

假设你有一个需求:将一个包含用户信息、存储在 CSV 文件中的列表,同步到一个 SQL 数据库中。

场景模拟

- 源文件 (

users.csv):textid,name,email 1,Alice,alice@example.com 2,Bob,bob@example.com

- 目标: 写入到 PostgreSQL 或 SQLite 的

users表中。

实现逻辑步骤

在 DataLank 的框架下,你只需要定义一个 Pipeline(管道),并将 CSVSource 和 SQLDestination 连接起来。

伪代码实现流程:

program UserDataMigration;

uses

DataLank.Core,

DataLank.Sources.CSV,

DataLank.Destinations.SQL;

var

MyPipeline: TDataPipeline;

CSVReader: TCSVSource;

SQLWriter: TSQLDestination;

begin

// 1. 初始化管道

MyPipeline := TDataPipeline.Create;

// 2. 配置源端:读取 CSV 文件

CSVReader := TCSVSource.Create('users.csv');

CSVReader.Delimiter := ',';

CSVReader.HasHeader := True;

// 3. 配置目的端:连接数据库

SQLWriter := TSQLDestination.Create('Host=localhost;DB=my_db;User=admin;Pass=123');

SQLWriter.TargetTable := 'users';

// 4. 建立链接并执行

MyPipeline.Connect(CSVReader, SQLWriter);

try

MyPipeline.Execute; // 开始搬运数据

writeln('Data migration completed successfully!');

finally

MyPipeline.Free;

CSVReader.Free;

SQLWriter.Free;

end;

end.

DataLank vs 传统 ETL 工具

| 特性 | 传统 ETL (如 Talend, Informatica) | DataLank |

|---|---|---|

| 部署复杂度 | 极高,需要服务器、JVM 等 | 极低,单文件可执行 |

| 资源消耗 | 内存占用大,启动慢 | 极轻量,启动即运行 |

| 学习曲线 | 陡峭,需要学习复杂 GUI | 平缓,基于简单的 Pascal 逻辑 |

| 灵活性 | 强,支持复杂转换 | 中,侧重于高效传输 |

| 适用场景 | 企业级大数据仓库 | 快速原型、轻量同步、自动化脚本 |

进阶:如何扩展 DataLank?

如果你需要支持一种新的数据格式(例如:从 MongoDB 迁移到 ElasticSearch),你可以通过继承基类来创建自己的适配器。

编写自定义 Source 的步骤:

- 继承

TDataLankSource类。 - 实现

NextRecord方法:定义如何从源端抓取下一条数据。 - 实现

Initialize方法:处理连接建立和权限验证。

编写自定义 Destination 的步骤:

- 继承

TDataLankDestination类。 - 实现

WriteRecord方法:定义如何将接收到的数据写入目标端。 - 实现

Finalize方法:处理事务提交或连接关闭。

总结与评价

DataLank 为那些厌倦了配置复杂 ETL 软件的开发者提供了一个清新的替代方案。它证明了 Pascal 语言在现代数据处理任务中依然具有竞争力——高效、稳定且结构清晰。

如果你正在寻找一个无需繁琐配置、能够快速实现“从 A 到 B”数据迁移的工具,或者你想研究如何构建一个高性能的解耦数据管道,DataLank 是一个绝佳的参考项目。

项目地址: https://github.com/stijnsanders/DataLank

还没有评论,来说两句吧...